引言

在 中提到了 Swagger 的基本使用,僅限於沒有參數,沒有驗證的那種api文檔生成,那麼這篇就連接上篇繼續,在一般具有安全性、權限等驗證的接口上,

都會在header/url中加上請求者的秘鑰、簽名等,當然也有可能添加到body等其它地方, Swashbuckle.AspNetCore 都支持這些寫法。

如何使用 — 下面將介紹兩種使用方式

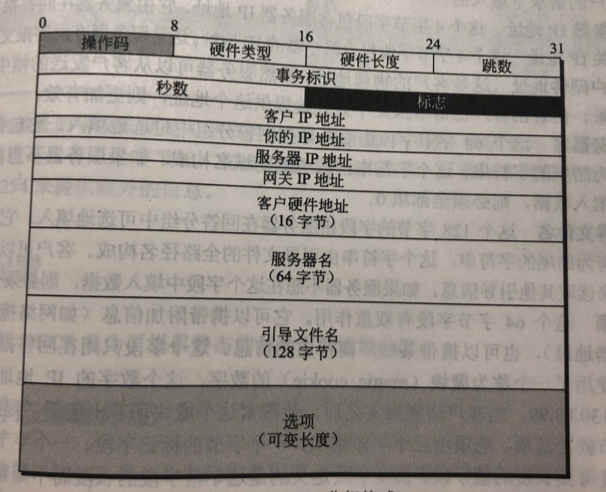

兩種方式參數設置到何處都是在 In屬性上,屬性對於值如下: 參考

- query: 參数字段值對應放在url中

- header: 參數值對應放在header param中

- body: 參數對應放到請求體中

- path: 參數應該對應放到請求路徑 // 具體貌似沒用

- formData: 參數對應放到請求表單中

第一種:將一個或多個參數保護API的“securityDefinitions”添加到生成的Swagger中。

這種是直接在文檔的右上方添加一個 Authorize 按鈕,設置了值后,每一個請求都會在設置的位置上加上相應的值,在 上一篇隨筆中的 ConfigureServices 方法中,

對應位置 services.AddSwaggerGen(options =>{}) 中的 XmlComments 下 添加代碼如下:

options.AddSecurityDefinition("token", new ApiKeyScheme { Description = "token format : {token}",//參數描述 Name = "token",//名字 In = "header",//對應位置 Type = "apiKey"//類型描述 }); options.AddSecurityDefinition("sid", new ApiKeyScheme { Description = "sid format : {sid}",//參數描述 Name = "sid",//名字 In = "header",//對應位置 Type = "apiKey"//類型描述 }); //添加Jwt驗證設置 設置為全局的,不然在代碼中取不到 options.AddSecurityRequirement(new Dictionary<string, IEnumerable<string>> { { "token", Enumerable.Empty<string>() }, { "sid", Enumerable.Empty<string>() }, });

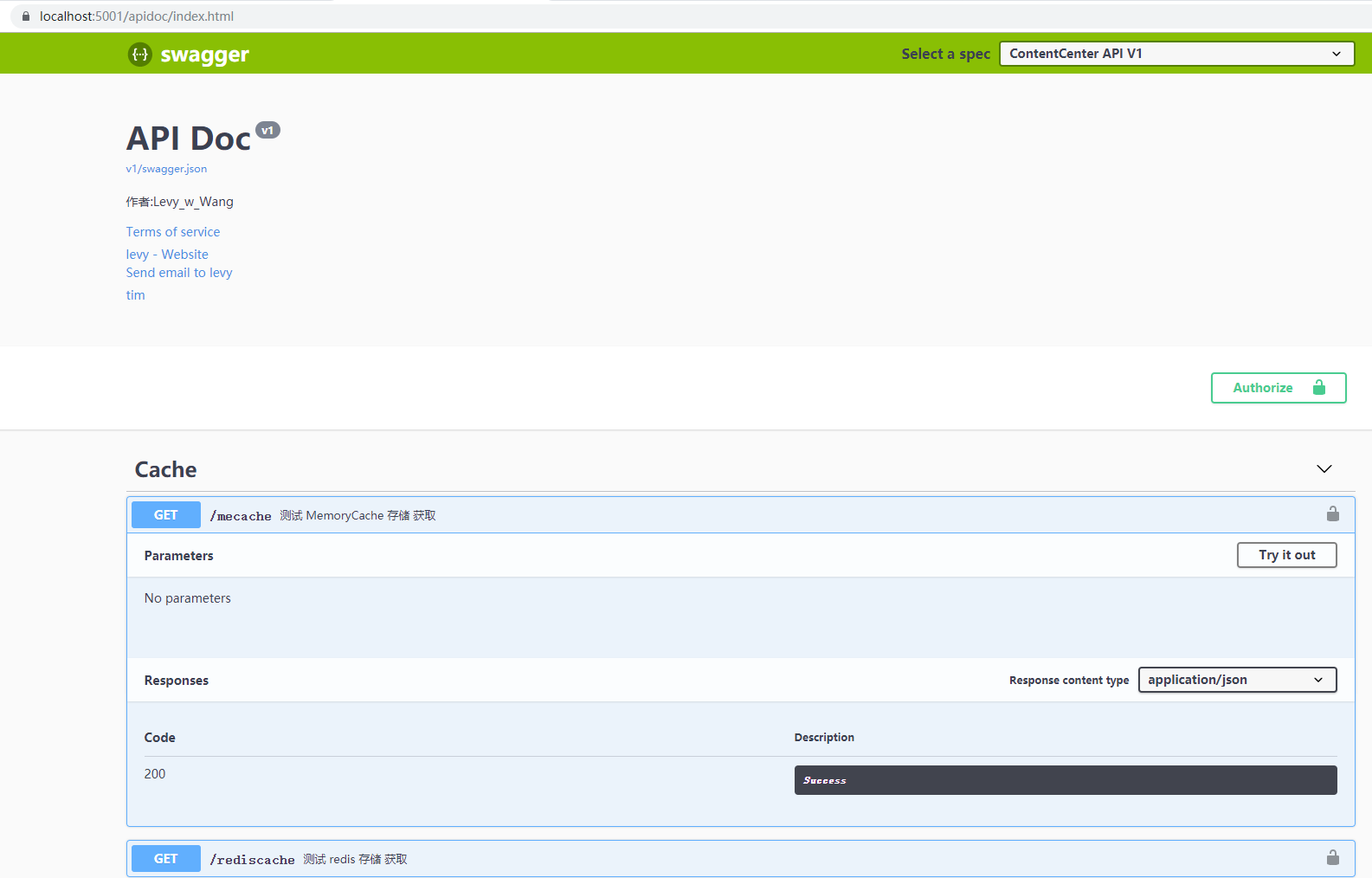

添加完成后,運行起來看下效果,效果圖:

設置上對應值,調用測試方法,可以在header中取到剛設置到的值,

這裡能看到,可以取到設置的參數了。這樣一來,在需要驗證的接口上,我們就可以通過接口文檔來測試了。基本不用再藉助postman等接口測試工具了。

但是,但是,這裡有一個問題,就是只要設置了參數值,每一次訪問都會在請求中帶上參數。

下面將介紹第二種方式,只給需要驗證用戶的接口上添加驗證參數。

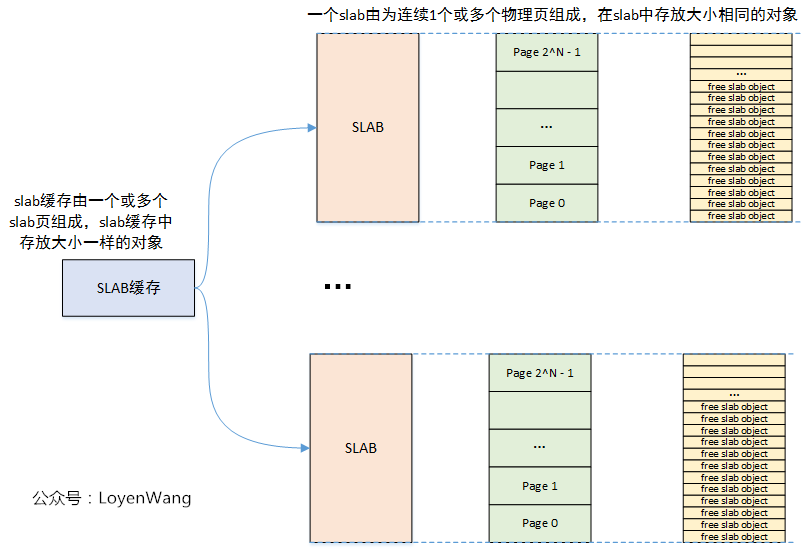

第二種:使用“filters”擴展Swagger生成器,來實現只在需要添加參數的方法上添加參數。複雜的可以根據自己的需求來添加對應參數

實現方式就是先新建一個類,名: SwaggerParameter ,實現 IOperationFilter 接口。SwaggerParameter 類代碼如下:

/// <summary> /// 自定義添加參數 /// </summary> public class SwaggerParameter : IOperationFilter { /// <summary> /// 實現 Apply 方法 /// </summary> /// <param name="operation"></param> /// <param name="context"></param> public void Apply(Operation operation, OperationFilterContext context) { if (operation.Parameters == null) operation.Parameters = new List<IParameter>(); var attrs = context.ApiDescription.ActionDescriptor.AttributeRouteInfo; var t = typeof(BaseUserController); //先判斷是否是繼承用戶驗證類 if (context.ApiDescription.ActionDescriptor is ControllerActionDescriptor descriptor && context.MethodInfo.DeclaringType?.IsSubclassOf(t) == true) { //再驗證是否允許匿名訪問 var actionAttributes = descriptor.MethodInfo.GetCustomAttributes(inherit: true); bool isAnonymous = actionAttributes.Any(a => a is AllowAnonymousAttribute); // 需要驗證的方法添加 if (!isAnonymous) { operation.Parameters.Add(new NonBodyParameter() { Name = "sid", In = "header", //query header body path formData Type = "string", Required = true,//是否必選 Description = "登錄返回的sid" }); operation.Parameters.Add(new NonBodyParameter() { Name = "token", In = "header", //query header body path formData Type = "string", Required = true,//是否必選 Description = "登錄返回的token" }); } } } }

運行起來后,進入到 文檔頁面,可以看到右上角的 Authorize 按鈕已經不見了,在不需要驗證的方法上,也找不到相應需要設置參數的輸入框。就只有在需要驗證的接口上才有。

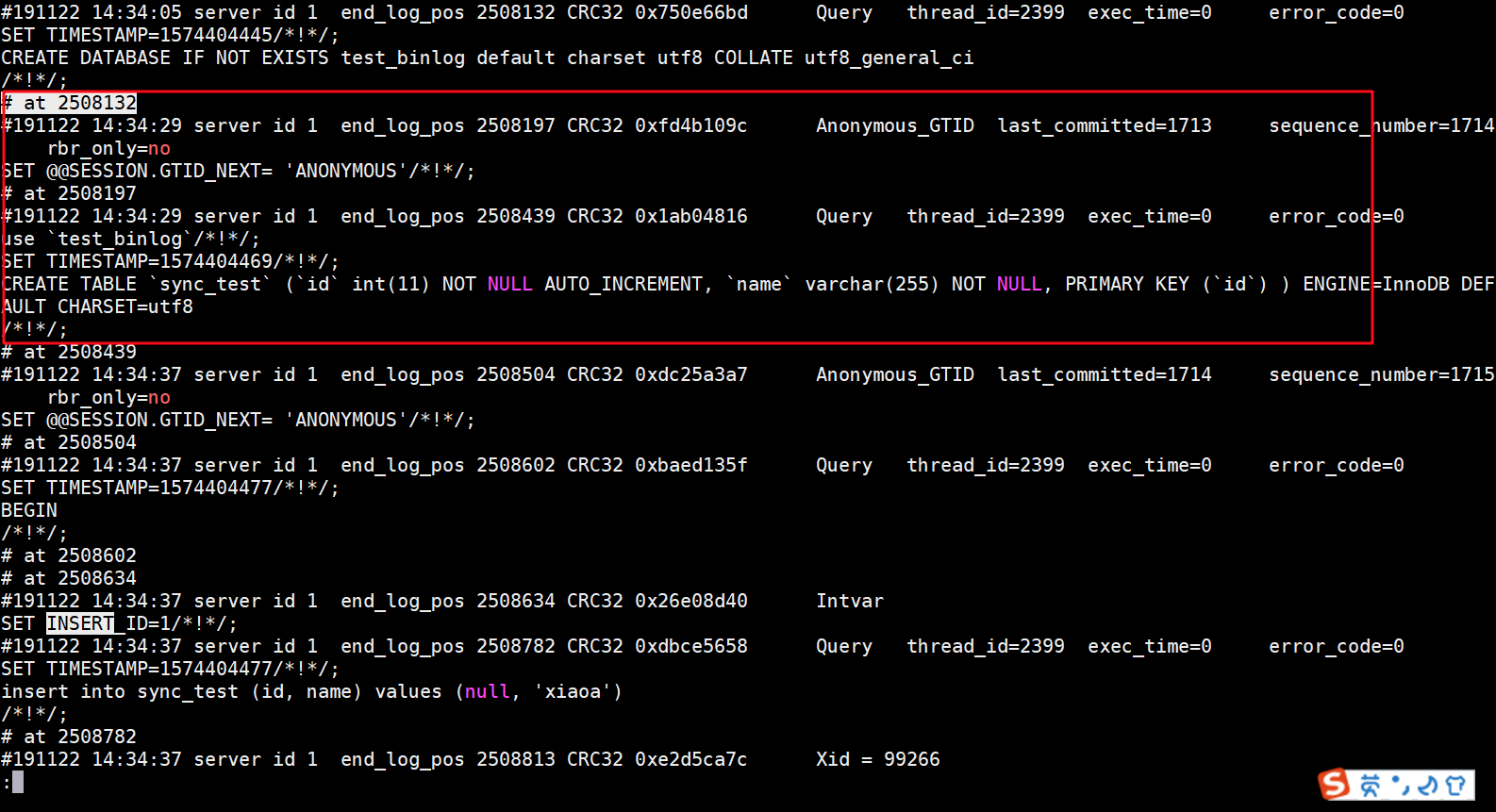

參考Swagger文檔圖如下:

參考代碼圖如下:

效果圖:

這樣一來設置也就完成了。從上面就能看出,就只有需要用戶驗證的接口才會有相應參數。

我的設置方式是先定義了用戶驗證控制器類,讓需要用戶驗證的控制器繼承該控制器,然後在該控制器中不需要用戶驗證的接口上加上 AllowAnonymous 屬性

設置fitter時就可以根據上面提到的兩個點來進行判斷是否需要加上參數,如果不是這樣實現的,可以根據自己的需求變更fitter類,來控制文檔的生成。

以上若有什麼不對或可以改進的地方,望各位指出或提出意見,一起探討學習~

有需要源碼的可通過此 鏈接拉取 覺得還可以的給個 start 和點個 下方的推薦哦~~謝謝!

本站聲明:網站內容來源於博客園,如有侵權,請聯繫我們,我們將及時處理【其他文章推薦】

※帶您來了解什麼是 USB CONNECTOR ?

※自行創業 缺乏曝光? 下一步"網站設計"幫您第一時間規劃公司的門面形象

※如何讓商品強力曝光呢? 網頁設計公司幫您建置最吸引人的網站,提高曝光率!!

※綠能、環保無空污,成為電動車最新代名詞,目前市場使用率逐漸普及化

※廣告預算用在刀口上,網站設計公司幫您達到更多曝光效益